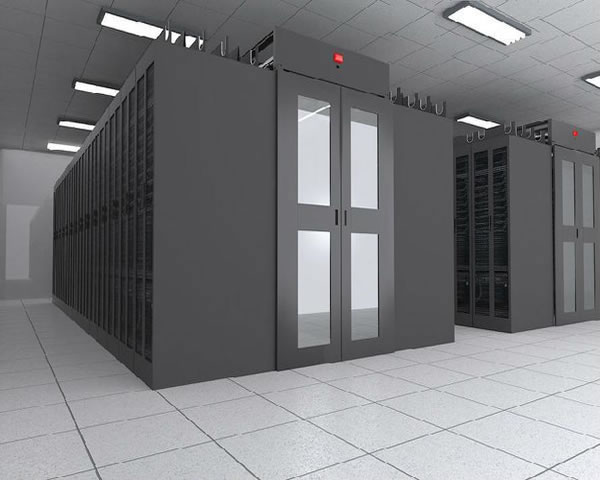

概览:最好、最佳与最便宜的部署选择

在讨论< b>澳门本地部署< b>特殊服务器用于< b>大数据与< b>AI训练时,"最好"通常指以NVIDIA H100、A100为核心、配备高速NVMe与Infiniband的机架式算力节点;"最佳"为成本与性能平衡,例如A30/A40或多卡A100混合方案;"最便宜"可选基于T4/A10或二手数据中心GPU的轻量化训练或边缘推理节点。选择应同时考虑澳门的数据主权、机房可用性以及与香港/大陆云网的互联延迟。

性能瓶颈与评估指标

评估< b>特殊服务器时,指标包括GPU算力(TFLOPS、显存大小)、CPU核心数与内存带宽、NVMe IOPS/吞吐、网络延迟与带宽(RDMA/InfiniBand),以及冷启动与IOPS对< b>大数据预处理的影响。实际训练关键看显存限制、PCIe/PCIe Gen5或HBM带宽和多卡互联效率(NCCL拓扑)。

GPU与CPU选型建议

对于深度学习训练,推荐企业级GPU(H100/A100/A30)配合支持PCIe Gen4/Gen5与足够PCIe通道的CPU平台。CPU方面优先选择多核高IPC的AMD EPYC或Intel Xeon,确保数据解压、预处理与吞吐匹配GPU。若预算有限,混合使用A10/T4做推理,A30做训练的组合能降低成本。

内存与存储配置

训练与大数据处理需大容量内存和低延迟存储。建议服务器使用DDR4/DDR5 ECC大内存,并配备NVMe SSD做本地高速缓存;后端可采用分布式文件系统(Ceph、Lustre)或对象存储(S3兼容)存放原始数据。对I/O密集型Pipeline,启用数据分片、本地预取与内存映射以降低NVMe压力。

网络与互连优化

网络是分布式训练的关键。推荐在澳门机房内部部署100/200/400GbE或InfiniBand HDR并支持RDMA,以减少跨节点同步延迟。若需与香港或公有云互联,优先选择低延迟专线或SD-WAN + 传输加速,避免跨境公网抖动影响训练一致性。

分布式训练与通信策略

采用NVIDIA NCCL、Horovod或PyTorch DDP等框架,并使用混合精度(AMP)与梯度累积降低通信频率。对于大模型,可考虑模型并行(ZeRO、Megatron-LM)和流水线并行,结合梯度压缩与异步更新以平衡通信开销与收敛速度。

数据管道与预处理优化

优化< b>大数据输入通道:使用TFRecord/LMDB等二进制容器减少解析时间,图像/视频采用预先转换并缓存到NVMe。启用多线程/多进程数据加载、数据预取和硬件加速解码(GPU解码)能显著提高GPU利用率。

虚拟化、容器与SLA考量

在澳门部署时,使用容器编排(Kubernetes + GPU Operator)便于资源弹性扩缩。对延迟敏感的训练任务最好使用裸机或GPU直通,避免虚拟化带来的抖动。制定明确的SLA和备份策略,保障长时间训练任务不中断。

软件栈、驱动与兼容性

确保使用兼容的CUDA、cuDNN、NCCL和驱动版本,并定期验证框架兼容性(PyTorch/TensorFlow)。对< b>AI训练采用容器化镜像并锁定依赖版本,可降低生产环境故障率。同时配置性能监控(nvidia-smi, Prometheus, Grafana)以快速定位瓶颈。

成本控制与本地化部署建议

在澳门选择本地数据中心时需考虑电力、散热和机柜成本。最佳成本策略为"本地计算+云突发":核心训练放在本地低延迟集群,训练峰值或超大模型临时溢出到香港或公有云。对于预算有限者,可选二手企业GPU或租用共置机柜以降低一次性CAPEX。

安全、合规与运维要点

处理敏感数据时,遵循当地法律与跨境传输规则,采用数据加密、访问控制与日志审计。运维方面建立自动化补丁、备份策略和健康检测,特别是GPU节点的温度与功耗监控,防止因过热或功耗限制出现降频。

结论与落地建议

总结:在澳门部署< b>特殊服务器用于< b>大数据与< b>AI训练应基于目标任务选择"最好"(H100+InfiniBand)或"最便宜"(T4/A10/二手)方案,并通过NVMe缓存、RDMA互联、混合精度训练、合理的分布式拓扑与本地+云的弹性策略实现性能优化。建议先做PoC测试节点,验证数据管道与网络延迟,再按负载渐进扩容。